Obecny wpis jest moim głosem w dyskusji na międzyuczelnianym (IFiS PAN, IF UW, środowisko filozoficzne PW) posiedzeniu seminarium pt. „Ku filozofii informatycznej”, 17.XI.2020. Dwa główne na tym posiedzeniu odczyty, profesorów Pawła Polaka („Filozofia informatyki, o jakiej nie śniło się informatykom”) i Kazimierza Trzęsickiego („Filozofia informatyczna i paradygmat Turinga”), mają pewien wspólny wątek — pankomputacjonizm, do którego chciałbym się odnieść w tych uwagach jako do szczególnie wyrazistej gałęzi filozofii informatycznej. Dobre tło dla tych uwag stanowi wprowadzenie do seminarium, autorstwa doktora Pawła Stacewicza.

§1. Anty-limitatywne twierdzenie Gödla, 1936, ilustrujące epistemiczny pankomputacjonizm jako gałąź filozofii informatycznej.

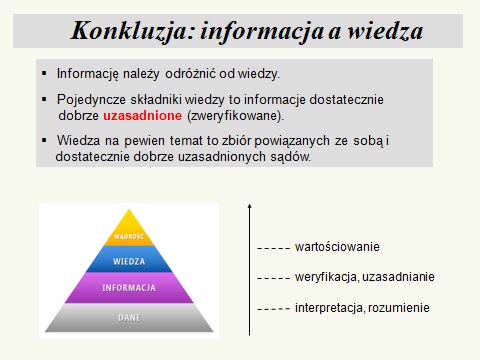

Posługując się terminem „pankomputacjonizm epistemiczny” należy wyjaśnić, od jakiego innego kierunku ma go odróżniać ten przymiotnik. Rzecz jest warta pilnej uwagi, bowiem ów inny kierunek jest rozległymi frapującym działem filozofii informatycznej. Proponuje określać go mianem pankomputacjonizm ontyczny, wkracza on bowiem w kwestię natury bytu glosząc myśl że podstawowym tworzywem świata nie są elementarne cząstki materii lecz bity czyli elementarne cząstki informacji. Wyraża tę myśl maksyma Johna Wheelera it from bit (można to oddać jako „byt z bitów”). Cała rzeczywistość jest według tej koncepcji gigantycznym komputerem cyfrowym przetwarzającym bity wedle algorytmu kierującego ewolucją wszechświata.

Jakkolwiek fantastycznie brzmi ta koncepcja, zasługuje ona na uwagę, skoro opowiada się za nią grupa tak wybitnych fizyków kwantowych i kosmologów, jak omawiany w odczycie prof. Trzęsickiego Konrad Zuse, wspomniany wyżej John Wheeler, a także Stephen Wolfram, Ed Fredkin, Frank Tipler i inni.

Uznawszy, że skierowanie do tekstu Trzęsickiego pozwala wspomnieć w paru tylko słowach komputacjonizm ontyczny, przechodzę do kwestii pankomputacjonizmu w wersji epistemicznej. Oto doniosłe stwierdzenie Gödla, dobrze się nadające na drogowskaz ku tej części filozofii informatycznej, jaką jest epistemiczny pankomputacjonizm.

Der Übergang zur Logik der nächst höheren Stufe bewirkt also nicht bloß, daß gewisse früher unbeweisbare Sätze beweisbar zu werden, sondern auch daß unendlich viele der schon vorhandenen Beweise außerordentlich stark abgekürzt werden können. — „Über die Lange von Beweisen”

Powiada w tym ustępie Gödel, że przejście do wyższego rzędu logiki powoduje nie tylko to, że dadzą się dowieść pewne twierdzenia dotąd niedowodliwe, lecz także to, że nieskończenie wiele już istniejących dowodów ulega nadzwyczajnemu skróceniu. Ciekawą tego egzemplifikacją w praktyce matematycznej jest w aksjomatyce Peano przejście od aksjomatu indukcji pierwszego rzędu do sformułowania w logice drugiego rzędu.

Dowód w rozumieniu tak Gödla jak iHilberta jest to dowód sformalizowany, a więc wykonalny lub sprawdzalny dla maszyny cyfrowej. Znaczy to, że każdy problem matematyczny da się rozwiązać algorytmicznie czyli obliczeniowo. W tym sensie ów pogląd Gödla zasługuje na określenie pankomputacjonizm, a przydawka epistemiczy odróżnia go od ontycznego.

Algorytmiczne rozwiązywanie kolejnych problemów poprzez wspinanie się na coraz wyższe rzędy logiki jest wymowną ilustrację fenomenu poznawczego, jakim jest twórcza konceptualizacja poprzez postulaty znaczeniowe (meaning postulates w sensie Carnapa 1947 ). Szczególnie ważnym ważnym dla postępu nauki środkiem są aksjomaty w teoriach sformalizowanych. Zachodzi to także w rozważanym przykładzie Gödla ponieważ każdy nowy rząd logiki jest określany przez swoiste dlań aksjomaty.

Tenże przypadek, ujawniając dobitnie doniosła i niezbywalną rolę filozofii w informatyce, harmonizuje z wypowiedzią prof.Polaka, że „filozofia okazuje się dla przyszłości informatyki równie ważna co umiejętności techniczne i ścisła wiedza”. Istotnie, żeby informatyka była zdolna do algorytmicznego rozwiązywania problemów w tak wydajny sposób, musi przyjąć ontologię platońską w sensie istnienia uniwersaliów pojętych jako zbiory w sensie teorii mnogości. Antyplatońska filozofia nominalizmu, np. reizm Kotarbińskiego, jest w tym względzie bezradna.

Twórcza konceptualizacja czyli inwencja pojęciowa to czynnik fundamentalny, obecny na każdym kroku postępu wiedzy. Spektakularnym przykładem takiej odkrywczości jest pojęcie zera. Poświęca mu wiele uwagi odczyt Trzęsickiego, poprzestanę więc na zauważeniu, że bez obecności tego obiektu w świecie liczb nie byłoby nawet najprostszych algorytmów czterech działań arytmetycznych. Gdyby przyjąć filozofię, które nie dopuszcza takich bytów jak zero, nigdy byśmy się nie doczekali maszyny Turinga.

Optymistyczny racjonalizm Gödla buduje się na założeniu, że gdy do rozwiązania jakiegoś problemu brak nam algorytmu, to należycie usilna praca inwencji pojęciowej doprowadzi do znalezienia pojęć, które po sprecyzowaniu przez aksjomatyzację oraz sformalizowaniu teorii aksjomatycznej dostarczy potrzebnego algorytmu.

§.2. Racjonalistyczny optymizm Gödla a stanowiska Hilberta i Turinga

§2.1. Moje propozycje w tej kwestii znajdują się m.in. w następujących artykułach, dostępnych w elektronicznych wersjach periodyków i w bazach danych po wklejeniu w wyszukiwarce całego tytułu.

Does Science Progress towards Ever Higher Solvability through Feedbacks between Insights and Routines? — „Studia Semiotyczne„, tom 32 nr 2, 2018. Odcinki 1.4, 2.2, 3.1, 3.2, 5.1, 5.2.

Jako komentarz do zwrotu Feedbacks between Insights and Routines niech posłużą dwie wypowiedzi koryfeuszy informatyki. Pierwsza pochodzi od Gregory Chaitina, druga od Donalda Knutha. Chaitin wyjaśnia, co nas upoważnia do epistemicznego pankomputacjonizmu w matematyce pomimo Gödlowskiego dowodu jej niezupełności.

Gödel’s own belief was that in spite of his incompleteness theorem there is in fact no limit to what mathematicians can achieve by using their intuition and creativity instead of depending only on logic and the axiomatic method. He believed that any important mathematical question could eventually be settled, if necessary by adding new fundamental principles to math, that is, new axioms or postulates. Note however that this implies that the concept of mathematical truth becomes something dynamic that evolves, that changes with time, as opposed to the traditional view that mathematical truth is static and eternal. […] In discovering and creating new mathematics, mathematicians do base themselves on intuition and inspiration, on unconscious motivations and impulses, and on their aesthetic sense, just like any creative artist would.

Z kolei, Knuth zwraca uwagę, że osiągnięte dzięki twórczej intuicji algorytmy pomagają tejże intuicji docierać do bogactwa interesujących własności obiektów matematycznych.

Być może największym odkryciem będącym rezultatem wprowadzenia komputerów okaże się to, że algorytmom, jako przedmiotom badania, przysługuje niezwykłe bogactwo interesujących własności oraz to, że algorytmiczny punkt widzenia jest użytecznym sposobem organizacji wiedzy w ogólności. […] ˙Najbardziej wartościowym elementem edukacji naukowej czy technicznej są służące ogólnym celom narzędzia umysłowe, które będą służyły przez całe życie. Szacuję, że język naturalny i matematyka są najważniejszymi takimi narzędziami, a informatyka stanowi trzecie narzędzie.

Tę myśl Knutha rozwija P.Stacewicz we wpisie „Algorytmiczne podejście do zdobywania, zapisywania i przekazywania wiedzy”, który następuje po obecnym.

§2.2. Inną moją pozycją, która traktuje szerzej o zagadnieniach poruszanych w obecnym tekście jest artykuł: The progress of science from a computational point of view: the drive towards ever higher solvability –– „Foundations of Computing and Decision Sciences„, Vol.44, No~1, 2019. Odcinki 3 i 4.

Tę optymistyczną myśl, że dla każdego matematycznego problemu istnieje w 0biektywnym świecie jestestw matematycznych rozwiązujący go algorytm, do którego zdoła dotrzeć po jakimś czasie myśl ludzka (o ile starczy na to czasu trwania cywilizacji), analizuje wszechstronny, a kończący się znakiem zapytania, fragment tekstu Pawła Stacewicza zatytułowany „A Discussion of Marciszewski’s Optimistic Realism” w książce „Interdisciplinary Investigations into the Lvov-Warsaw School” (redakcja A.Drabarek, J.Woleński, M.Radzki), Palgrave 2019.

Zdobywamy głębszy wgląd w powyższą myśl Gödla, biorąc pod uwagę jego odwoływanie się do fenomenologii Husserla w próbach uzasadnienia epistemicznego optymizmu. Ujawnia się wtedy zakorzenienie tej kwestii w metafizyce, co nie rokuje szybkiego rozwiązania. Stanowi jednak atrakcyjne wyzwanie dla badaczy, których nie odstrasza ryzyko metafizycznych spekulacji.